Wer glaubt, dass ein einzelner Prompt die komplette SEO-Strategie ersetzt, hat Agentic AI nicht verstanden. In meiner Session-Auswahl auf der OMX 2025 war der Talk von David Konitzny (Kosch Klink Performance) zum Thema “KI-Automatisierung im SEO & Content Marketing” ein Pflichttermin. Warum? Weil er genau das adressiert, woran ich aktuell gemeinsam mit Paul arbeite, um unser Unternehmen zukunftssicher aufzustellen: Wie transformieren wir stupide manuelle Arbeit in intelligente, automatisierte Software-Architekturen?

David hat nicht nur an der Oberfläche gekratzt, sondern ist tief in die Workflows eingestiegen. Hier sind meine Takeaways aus Software-Engineering- und Growth-Perspektive.

Das Navi für den SEO-Dschungel

David startete mit einer simplen, aber treffenden Metapher: Die klassische Auto-Navigation. Früher Karte lesen (manuell, fehleranfällig), heute Ziel eingeben und optimierte Route fahren (automatisiert, datenbasiert).

Genau an diesem Punkt stehen wir im SEO.

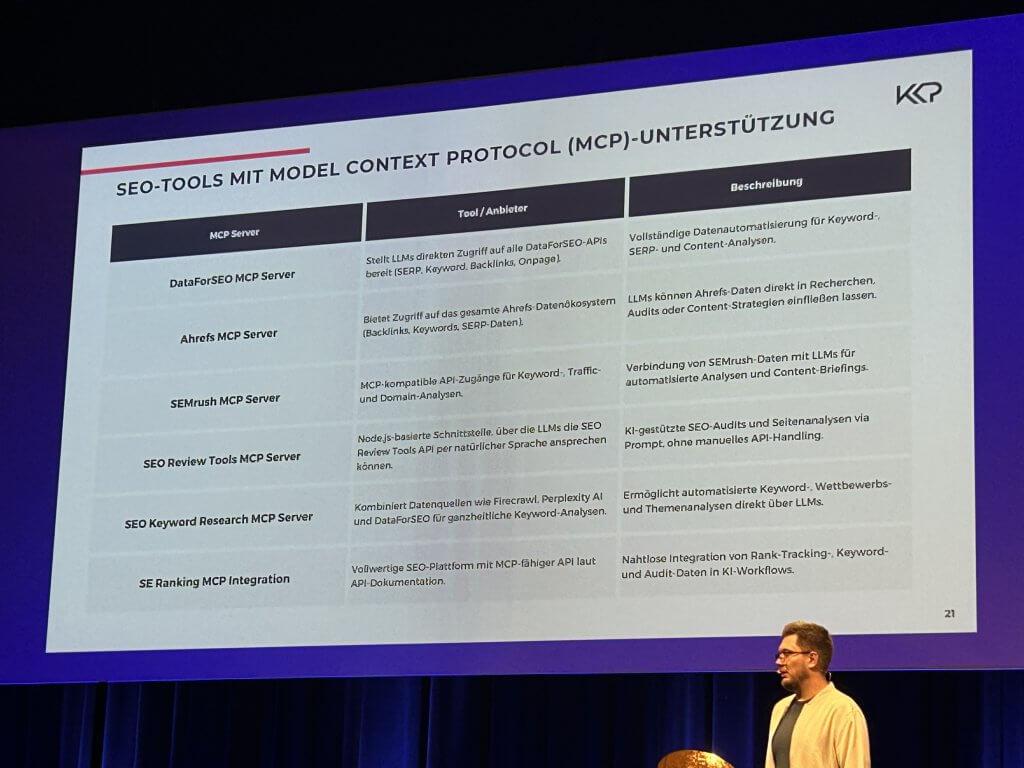

Wir brauchen Daten – nicht für uns, sondern als Treibstoff für Agentic Workflows. Aber die Beschaffung und Verarbeitung darf keine manuelle Zeit mehr kosten. Hier sehe ich ganz klar uns Developer in der Pflicht: Wir müssen die Agentic Architecture bauen. Es ist unsere Aufgabe, API-Schnittstellen bereitzustellen – und hier kommen MCPs (Model Context Protocols) ins Spiel. Es gibt bereits hervorragende Anbindungen, die wir nutzen können, um autonome Agents direkt und standardisiert operieren zu lassen. Damit befreien wir das Marketing-Team aus der Excel-Hölle und dem Tool-Chaos. Das Ziel? Systeme, die selbstständig agieren, damit wir uns auf die strategischen Entscheidungen konzentrieren können.

Playbook First, Automation Second

Ein Punkt, der voll auf meine “Pre-Mortem”-Mentalität einzahlt: Bevor du auch nur eine Zeile Code schreibst oder einen Agent aufsetzt, brauchst du ein Playbook. Könnte bei dem einen oder anderen in meinem Team für Stirnrunzeln sorgen – nicht immer gibt es einen Plan 😉

Du musst dich fragen: Was genau kann ich überhaupt automatisieren?

Wer ohne Plan automatisiert, skaliert nur das Chaos. Davids Ansatz ist hier strikt logisch: Prozess verstehen, Schritte definieren, dann die Maschine anwerfen. Das ist Agentic Thinking in Reinform. Pre-Mortem klingt hart aber man muss auch scheitern einplanen! STRG+A+Entf und von vorne Starten.

Granularität gewinnt: Tod dem Riesen-Prompt

Das wichtigste Learning für alle, die noch versuchen, ChatGPT mit einem 2000-Wörter-Prompt dazu zu bringen, einen perfekten Artikel inklusive Keyword-Recherche zu schreiben: Lass es.

David propagiert (zu Recht) Granularität. Wir brauchen keine “One-Size-Fits-All”-Lösung, sondern viele spezialisierte Agents, die Fragmente erledigen.

- Agent A holt die Keywords.

- Agent B clustert sie.

- Agent C schreibt das Outline.

Das deckt sich 1:1 mit unseren Erfahrungen bei KLIXPERT. Modularität ist der Schlüssel zu wartbaren und skalierbaren Systemen.

Tech-Stack: Old Gold & New Toys

Technisch wurde es spannend beim Einsatz von DataForSeo via MCP (Model Context Protocol). Das war Balsam für meine Entwickler-Seele, da wir DataForSeo bei uns in der Company bereits intensiv für diverse Growth-Hacks nutzen. Es zeigt, dass wir technologisch auf dem richtigen Dampfer sitzen.

Interessant war der Rückgriff auf TF-IDF (Termlabs). Ein Klassiker – “Old but Gold”. Das hat mich direkt an eine Diskussion mit Bernhard aus meinem Team erinnert; wir haben früher Xovi genau dafür genutzt. Dass diese Metriken in einer AI-Welt immer noch ihren Platz haben, um Relevanz messbar zu machen, ist ein wichtiges Signal. AI erfindet das Rad nicht neu, sie dreht es nur schneller.

Ein weiteres Highlight: Der Performance Score. Die Idee, AI zu nutzen, um die menschliche Bewertungsperspektive zu simulieren (“Würde ein User das gut finden?”), ist smart. Wir nutzen LLMs also nicht nur zur Erstellung, sondern auch als Quality Gate.

Mein Fazit

Davids Session gab einen soliden Einblick in den Aufbau moderner Tool-Chains. Wenn ich zurückblicke und realisiere, dass wir diesen ganzen Prozess vor 1-2 Jahren noch händisch, manuell und schmerzhaft langsam durchgeführt haben, ist das schon krass.

Die Vorstellung, dass wir diese stupiden, repetitiven Tasks jetzt dauerhaft an Maschinen delegieren können, ist Balsam für die Seele. Es gibt uns die Freiheit, uns wieder auf Strategie, Kreativität und echte Innovation zu fokussieren.

Tools & Begriffe

Um die technischen Aspekte des Recaps einzuordnen, hier eine kurze Erklärung der genannten Tools und Konzepte:

- DataForSeo: Eine mächtige API-Lösung, die Rohdaten für SEO und digitales Marketing liefert (SERP-Daten, Keyword-Daten, Labs). Für uns Entwickler essentiell, um eigene SEO-Tools oder Dashboards zu bauen, ohne eigene Scraper warten zu müssen.

- MCP (Model Context Protocol): Ein offener Standard, der es KI-Modellen ermöglicht, sicher und standardisiert auf externe Daten und Tools zuzugreifen. Er fungiert als universeller “Stecker”, um LLMs (wie Claude oder GPT) mit deinen lokalen Daten oder APIs zu verbinden.

- TF-IDF (Term Frequency-Inverse Document Frequency): Ein statistisches Maß, das bewertet, wie wichtig ein Wort in einem Dokument im Verhältnis zu einer Sammlung von Dokumenten ist. Im SEO hilft es (via Tools wie Termlabs), die semantische Relevanz eines Textes zu optimieren, ohne ins Keyword-Stuffing zu verfallen.

Über den Speaker: David Konitzny

David berät Unternehmen dabei, ihre Sichtbarkeit in einer hybriden Suchlandschaft aus klassischen Algorithmen und KI-Systemen zu sichern. Bei Kosch Klink Performance entwickelt er datengetriebene SEO- und AI-Search-Strategien. Er analysiert Plattformen wie Google, Gemini und Perplexity nicht nur oberflächlich, sondern mit technischer Tiefe. Sein Fokus liegt darauf, komplexe Mechanismen in umsetzbare Empfehlungen zu übersetzen – von neuen SERP-Formaten bis hin zu generativen Assistenten.

Meine Posts zur SEOkomm 2025

- Agentic Workflows statt One-Prompt-Wonder – KI-Automatisierung im SEO

- The Next Frontier of Discovery – Von Suchergebnissen zu echter “Action”

- Browser-Based SEO – Warum die Chrome DevTools dein stärkster Hebel sind

- Relaunch done right – Vektor-Embeddings, Screaming Frog & warum Perfektionismus dein Ranking killt

- Vom SEO-Dashboard zum GEO-Framework – Belastbare KPIs für die neue Ära der Suche

- Die harte Wahrheit über Traffic & die 10%, die bei SEO & AEO den Unterschied machen

Was ist die SEOkomm 2025 und OMX (Online Experts Days) 2025

Die SEOkomm und die OMX (Online Experts Days) sind die beiden zentralen Fachkonferenzen der sogenannten “Online Expert Days” (OXD), die jährlich in Salzburg stattfinden und als führende Weiterbildungsveranstaltung für die digitale Marketingbranche im deutschsprachigen Raum gelten. Die OMX, welche am ersten Tag (27. November 2025) stattfindet, konzentriert sich auf das breite Feld des Online Marketings – inklusive E-Commerce, Social Media, SEA (Search Engine Advertising), B2B Marketing und mehr. Die SEOkomm am darauffolgenden Tag (28. November 2025) legt den Fokus dezidiert auf die Suchmaschinenoptimierung (SEO) und behandelt Themen wie Technical SEO, Content-Strategien, KI im Digital Marketing sowie aktuelle Trends und Tools.